شیائومی از نسل جدید هوش مصنوعی MiMo رونمایی کرد

شیائومی که چند هفته پیش مدل MiMo-V2-Pro را منتشر کرده بود، حالا از دو مدل جدید با نامهای MiMo-V2.5 و MiMo-V2.5-Pro رونمایی کرده است. این مدلها بهصورت همزمان دارای قابلیت پردازش تصویر، ویدیو و صدا هستند.

برخلاف نسل قبلی که فقط متن و کد را پردازش میکرد، MiMo-V2.5 قادر به درک و پردازش همزمان تصویر، ویدیو و صدا است. برای مثال، با این قابلیت میتوانید عکس یخچال خود و محتویات آن را آپلود کرده و دستور پخت غذا دریافت کنید یا از یک ویدیوی آموزشی خلاصه گامبهگام تهیه کنید.

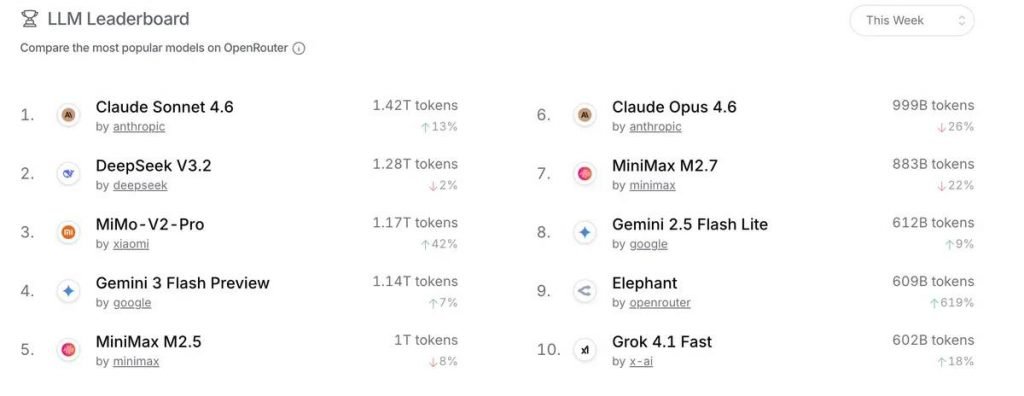

شیائومی ادعا میکند که MiMo-V2.5-Pro در قابلیتهای عاملمحور، مهندسی نرمافزار پیچیده و وظایف بلندمدت، پیشرفت بزرگی داشته و با مدلهای پیشرفتهای مانند Claude Opus 4.6 و GPT-5.4 در بسیاری از بنچمارکهای مربوط به کدنویسی و ایجنتها رقابت میکند.

موارد استفاده از مدلهای جدید شیائومی

مدلهای MiMo-V2.5 و MiMo-V2.5-Pro با اهداف متفاوتی توسعه داده شدهاند. طبق توضیحات شیائومی، مدل MiMo-V2.5-Pro میتواند وظایف حرفهای پیچیدهای که ممکن است انسانها چندین روز مشغول آنها باشند را انجام دهد. این مدل با سرعت ۶۰ تا ۸۰ توکندرثانیه کار میکند و هزینه آن ۱ دلار ورودی و ۳ دلار خروجی به ازای هر میلیون توکن است.

MiMo-V2.5 نیز بهعنوان یک مدل برای وظایف روزمره معرفی شده است. این مدل سریعتر (۱۰۰ تا ۱۵۰ توکن در ثانیه) و ارزانتر (۰.۴ دلار ورودی و ۲ دلار خروجی) است و همچنان از تصویر، صدا و ویدیو پشتیبانی میکند.

هر دو مدل دارای پنجره زمینه ۱ میلیون توکنی هستند که به آنها امکان میدهد حدود ۷۵۰ هزار کلمه را در یک مکالمه واحد پردازش کنند.

عملکرد مدلهای هوش مصنوعی شیائومی در بنچمارک

در بنچمارک کدنویسی SWE-bench Pro، مدل MiMo-V2.5-Pro موفق به حل ۵۷.۲ درصد از وظایف شده است که این رقم بسیار بالاتر از میانگین ۲۵ درصدی مدلهای دیگر است. در معیارهایی مانند τ3-bench و ClawEval، عملکرد این مدل نزدیک به Claude Opus 4.6 و GPT-5.4 بوده است.

بااینحال، در آزمون Humanity’s Last Exam که شامل مسائل چندین رشته دانشگاهی میشود، MiMo امتیاز ۴۸ درصد را کسب کرده، درحالیکه GPT-5.4 به امتیاز ۵۸.۷ درصد رسیده است.

این مدل هماکنون از طریق AI Studio شیائومی قابل دسترس است و از طریق Xiaomi MiMo API نیز میتوان به آن دسترسی داشت. غول چینی که در ماههای اخیر تمرکز ویژه روی عرضه مدلهای هوش مصنوعی داشته، اعلام کرده که درحال آموزش نسل بعدی مدلها با «استدلال عمیقتر، ادغام دقیقتر ابزارها و پایهریزی غنیتر در دنیای واقعی» است.